[펌·클리앙] 바이브코딩으로 DeepL 스러운 걸 만들었습니다.

회사에서는 그냥 기술영업맨인데 부업으로 번역을 좀 합니다. 10년 넘게 했더니 이제는 거래처들이 굵직굵직하고, 요즘 시기에도 번역일이 잘 들어옵니다. 종종 DeepL을 이용하는데, 요즘 AI가 이렇게나 발달했는데, 굳이 DeepL 구독을 해야 할까? 생각이 들더군요. 그래서 DeepL 스러운 로컬 번역기를 만들었습니다.

직접 사용해보며 기능은 조금씩 추가할 건데, '파일 번역' 기능은 아직 계획에 없습니다. 파일 번역은 이미지나 표 번역이 어렵더군요. AI 기술이 좀 더 발전하면 추가할지도 모릅니다..쿨럭.

비개발자가 이정도 만들었다는 것에 격려 부탁드려요 ㅎㅎ

LocalTranslator는 GitHub에서 무료로 내려받을 수 있습니다.

다운로드 주소: https://github.com/tz1012/LocalTranslator/releases/latest

______

설치 및 사용법:

클라우드 번역 서비스는 편리하지만, 텍스트를 외부 서버로 보낸다는 점에서 개인 정보 보호가 걱정될 수 있습니다. 또한 비용도 만만치 않죠. Google 번역기는 유용하지만 번역 품질도 마음에 들지 않고, 무엇보다 인터넷에 연결되어 있어야 이용할 수 있습니다. LocalTranslator는 이 문제를 해결해 줍니다. 로컬 LLM(대형 언어 모델)을 내 PC에서 직접 실행하고, 데이터를 외부로 내보내지 않으면서 고품질 번역을 즐길 수 있는 도구입니다. 이 글에서는 LM Studio 설치부터 LocalTranslator 연결까지 전 과정을 단계별로 안내합니다.

필요 사항:

Windows PC (RAM 8GB 이상 권장, 모델 크기에 따라 다름)

저장 공간 약 7GB 이상 (모델 파일 포함)

LM Studio - 로컬 AI 서버 역할을 하는 앱

LocalTranslator - LM Studio와 연결되는 번역 전용 앱

1단계: LM Studio 설치

LM Studio는 로컬 LLM을 다운로드하고 API 서버로 실행해 주는 앱입니다. https://lmstudio.ai 에서 무료로 다운로드할 수 있습니다.

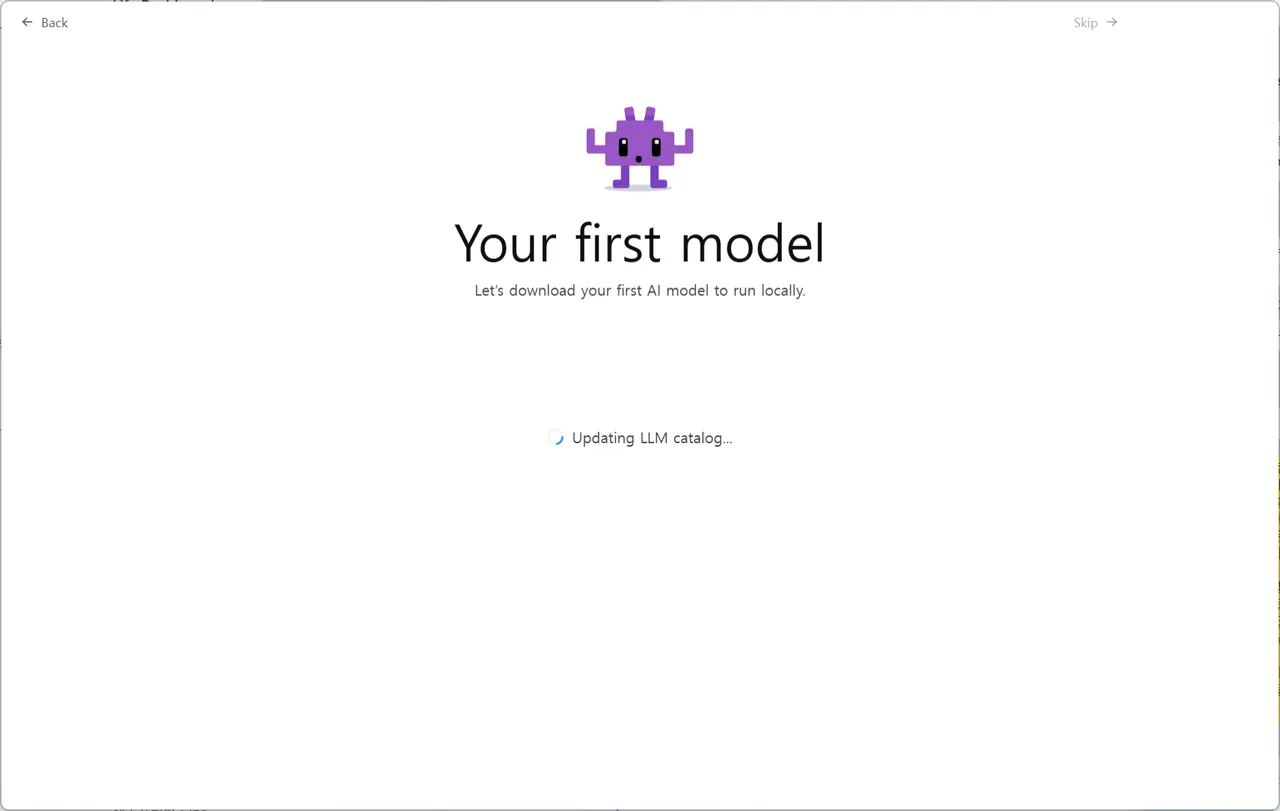

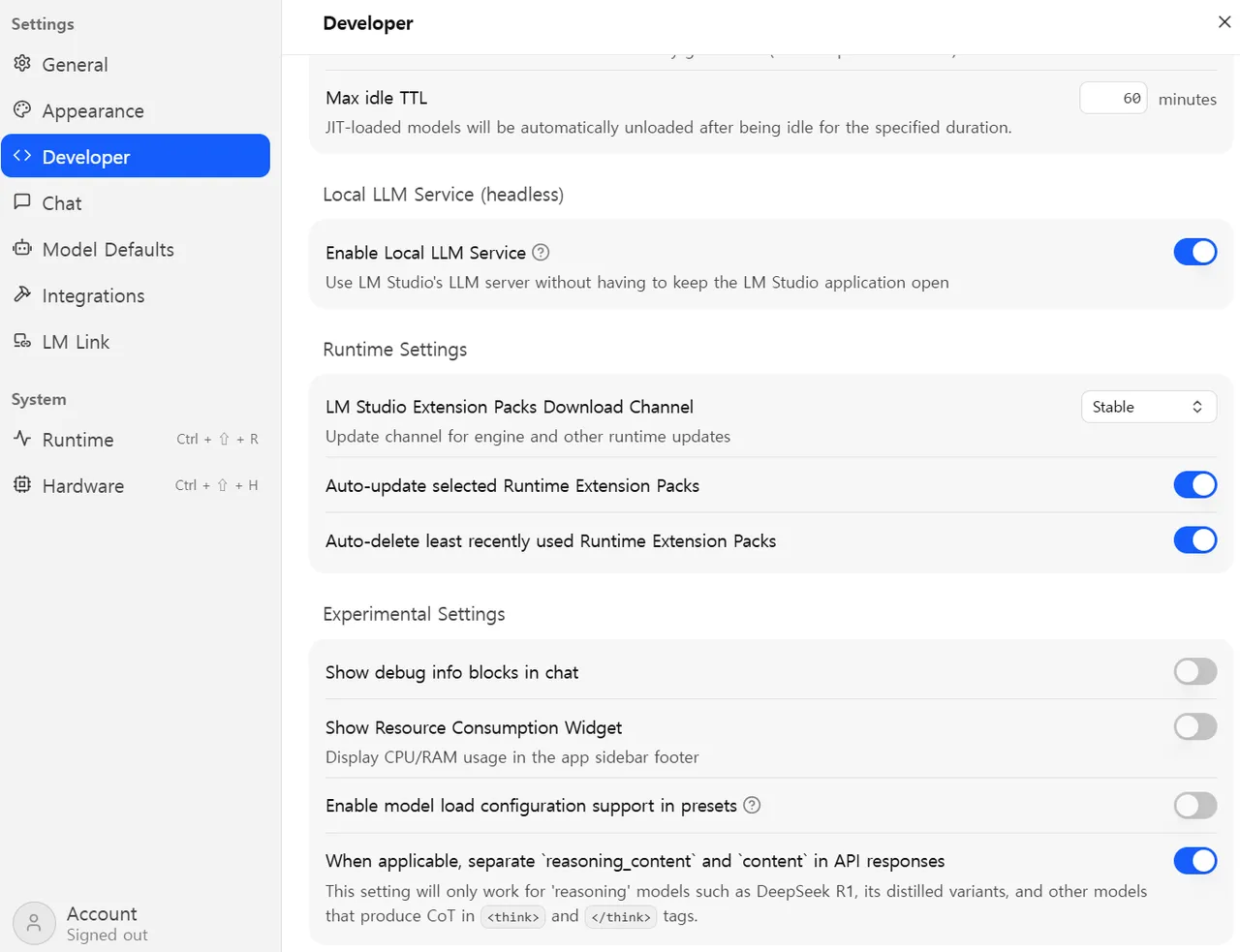

설치 후 처음 실행하면 온보딩 화면이 나타납니다. "설정 > Developer"에서 "Enable Local LLM Service" 옵션을 켜두면 서버가 자동으로 시작되어 편리합니다.

참고: Developer Mode는 고급 설정이 필요할 때 켜는 옵션으로, 일반 사용에서는 꺼두어도 무방합니다.

2단계: AI 모델 다운로드 (google/gemma-4-e4b)

LocalTranslator와 함께 사용할 모델을 다운로드합니다. 이 가이드에서는 google/gemma-4-e4b (7.9B 파라미터)를 사용합니다. 이미지 입력, 추론, 도구 호출을 지원하는 효율적인 모델입니다.

다운로드 방법

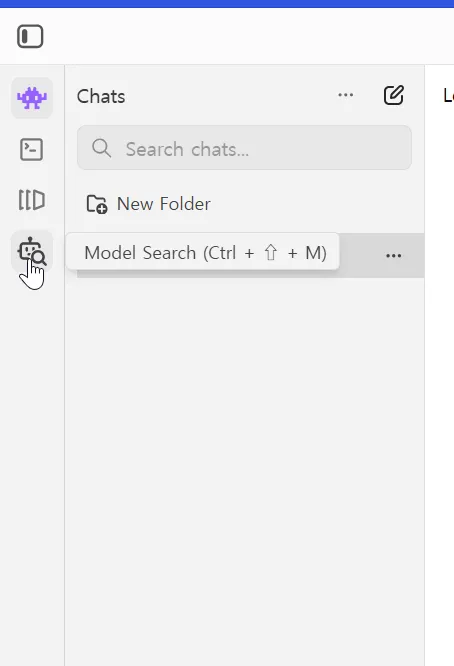

1. LM Studio 왼쪽에서 Model Search 아이콘을 클릭합니다.

2. 검색창에 gemma 4 e4b를 입력합니다.

3. google/gemma-4-e4b 항목의 Download 버튼을 클릭합니다.

다운로드가 시작되면 진행률이 표시됩니다. 6.33GB 용량이므로 인터넷 속도에 따라 수십 분이 걸릴 수 있습니다.

3단계: LM Studio 로컬 서버 시작

모델 다운로드가 완료되면 LM Studio의 로컬 서버를 켜야 합니다. LocalTranslator는 이 서버를 통해 AI 모델과 통신합니다.

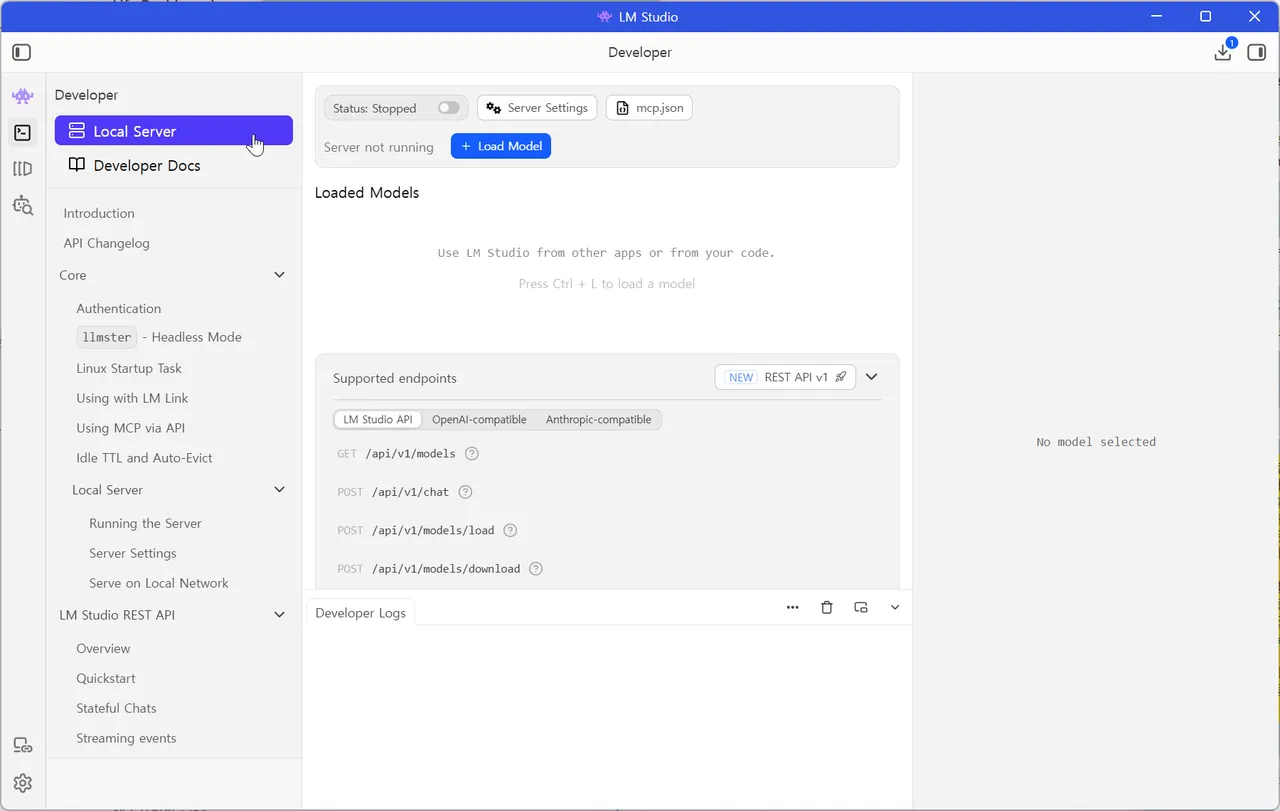

1. LM Studio 왼쪽 사이드바에서 Developer 아이콘을 클릭합니다.

2. Local Server 탭을 선택합니다.

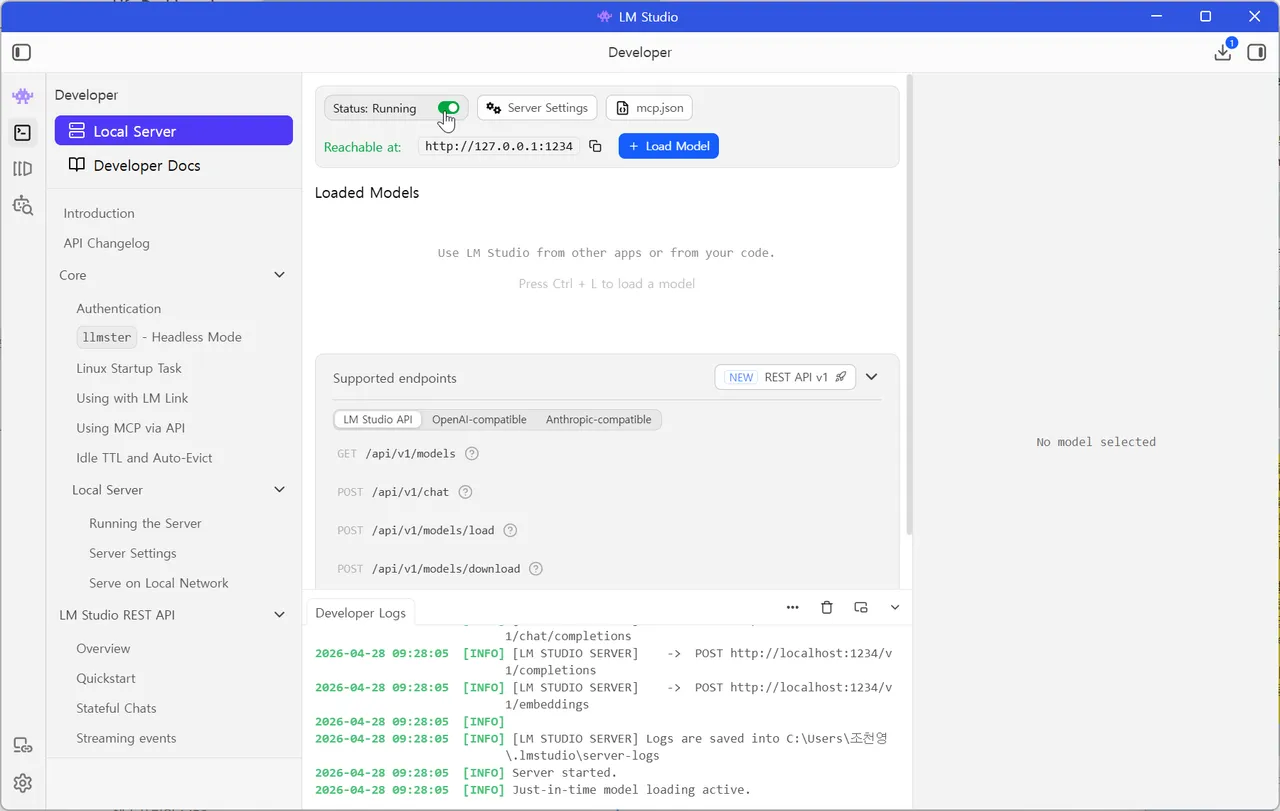

3. Status: Stopped 옆의 토글을 켜고, +Load Model을 눌러 켜서 다운로드한 모델을 선택합니다.

4. Status: Running 및 Reachable at: http://127.0.0.1:1234 가 표시되면 성공입니다.

중요* LocalTranslator를 사용할 때는 LM Studio 서버가 항상 실행 중이어야 합니다. 서버가 꺼져 있으면 번역이 작동하지 않습니다.

4단계: LocalTranslator 설치

LocalTranslator는 GitHub에서 무료로 내려받을 수 있습니다.

다운로드 주소: https://github.com/tz1012/LocalTranslator/releases/latest

최신 파일 (현재: LocalTranslator-v0.6.6-Setup.exe) 을 다운로드한 후 실행합니다.

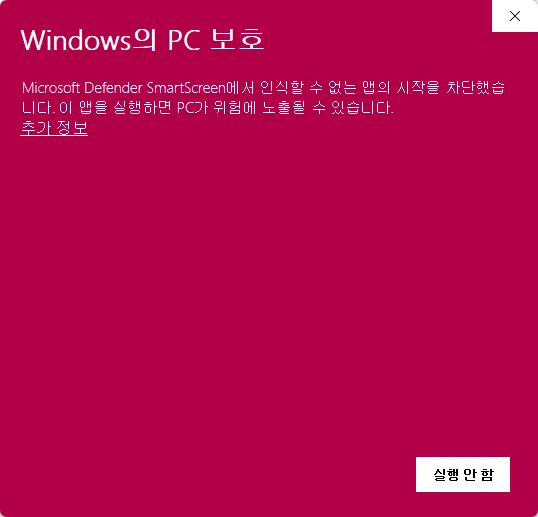

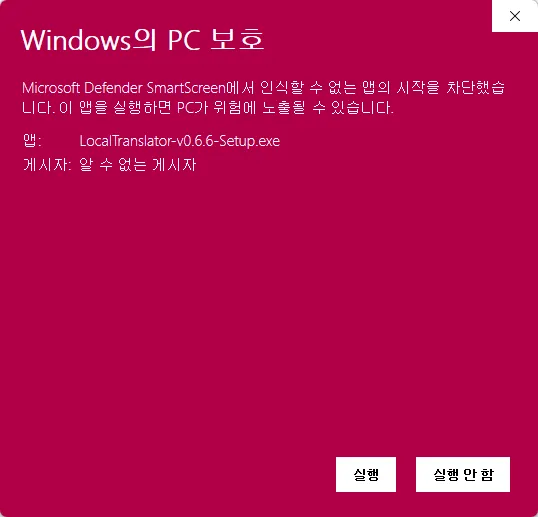

Windows SmartScreen 경고 처리

설치 파일을 실행하면 "Windows의 PC 보호" 경고가 나타날 수 있습니다. 이는 소규모 개발자가 배포한 앱에서 흔히 나타나는 현상으로, 악성 소프트웨어가 아닙니다.

첫 번째 화면에서 "추가 정보" 링크를 클릭합니다.

그러면 "실행" 버튼이 나타납니다. 클릭하여 설치를 진행합니다.

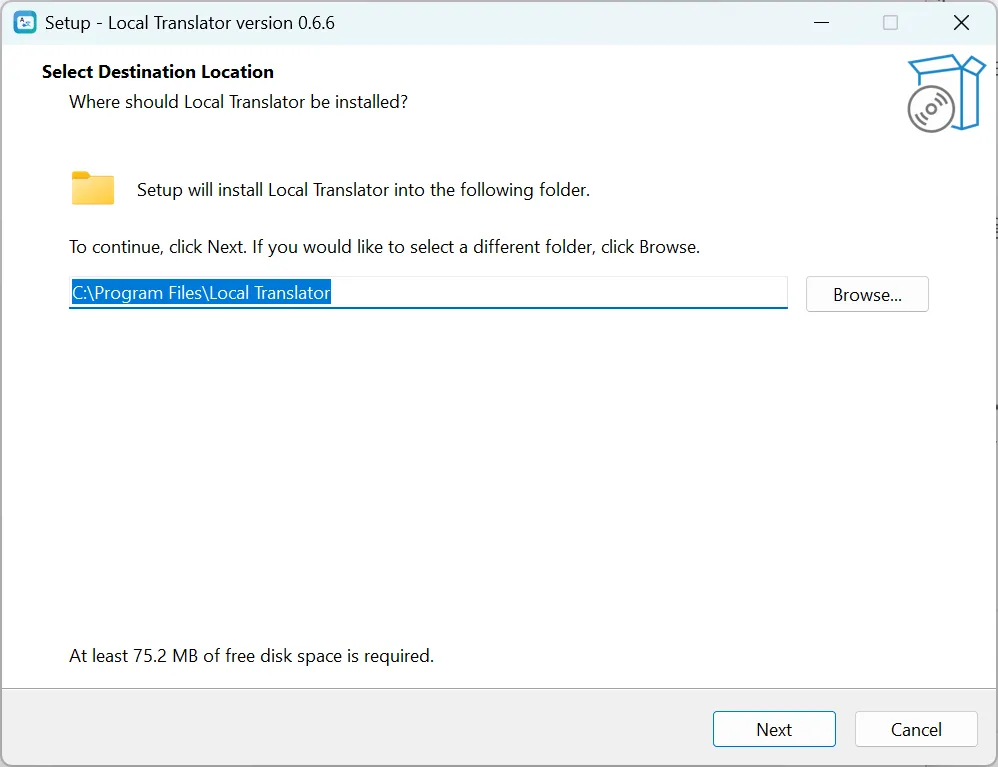

설치 경로는 기본값인 C:\\Program Files\\Local Translator를 그대로 사용해도 됩니다. Next 를 눌러 설치를 완료합니다.

5단계: LocalTranslator 설정 및 사용

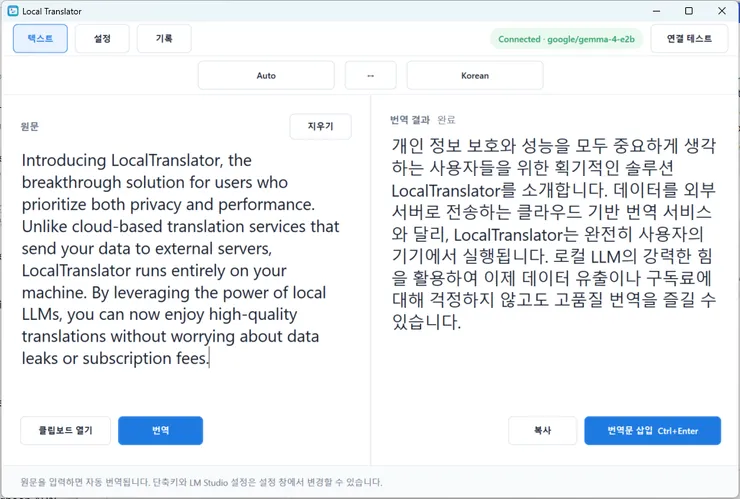

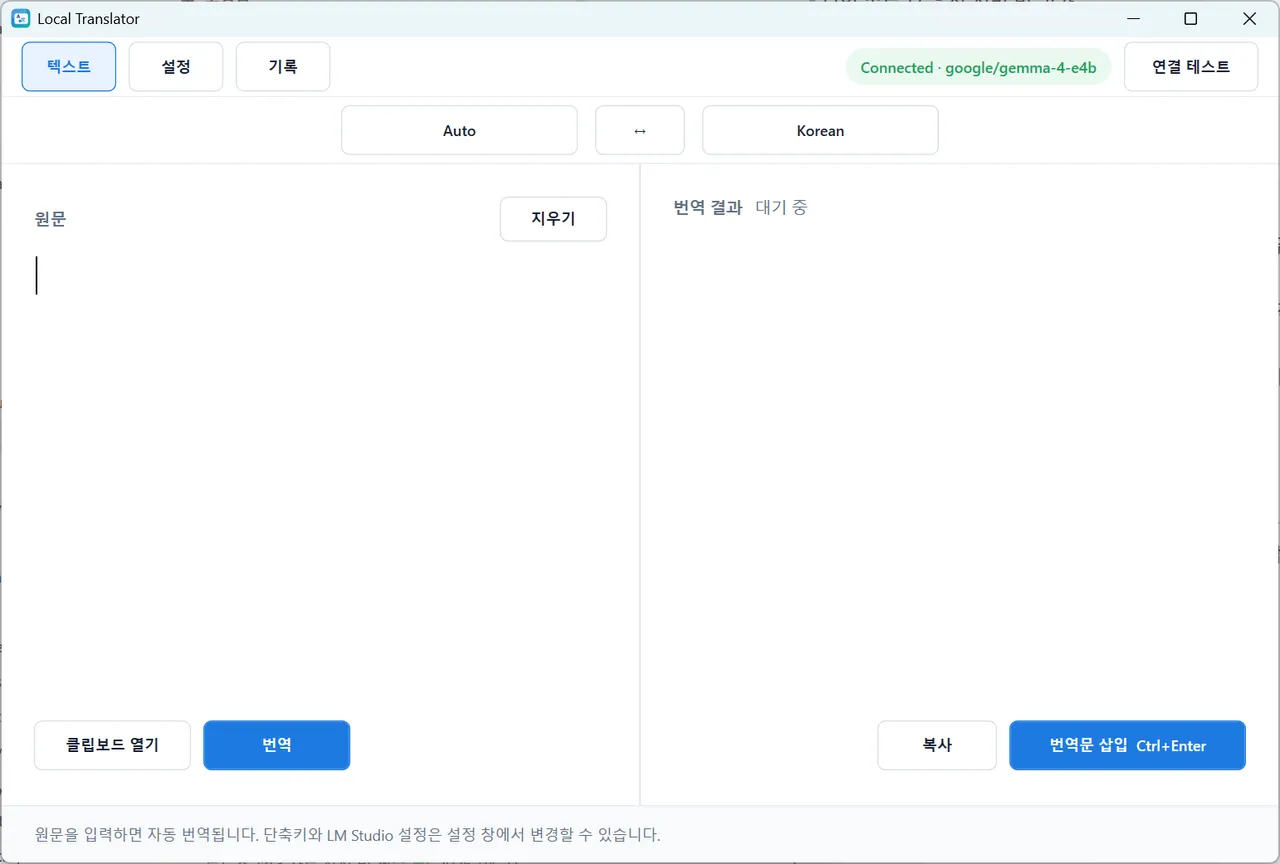

설치 후 LocalTranslator를 실행하면 메인 화면이 나타납니다.

LM Studio 연결 확인

앱 우측 상단에 "Connected · google/gemma-4-e4b" 와 같이 초록색으로 표시되면 LM Studio 서버와 정상적으로 연결된 것입니다.

연결이 안 될 경우 "연결 테스트" 버튼을 눌러 상태를 확인하세요.

번역 사용하기

1. 왼쪽 원문 입력창에 번역할 텍스트를 붙여넣습니다.

2. 언어 설정에서 소스 언어(Auto 자동 감지 가능)와 대상 언어(예: Korean)를 선택합니다.

3. 번역 버튼을 클릭하거나 텍스트를 입력하면 자동으로 번역됩니다.

4. 번역 결과는 오른쪽 창에 표시됩니다.

번역된 텍스트는 복사 버튼으로 클립보드에 복사하거나, 번역문 삽입 (Ctrl+Enter) 단축키로 현재 작업 중인 앱에 바로 붙여넣을 수 있습니다.

문제 해결

"LM Studio response error 400: Model is unloaded" 오류

이 오류는 LM Studio 서버는 실행 중이지만 모델이 메모리에 로드되지 않은 상태일 때 발생합니다.

해결 방법:

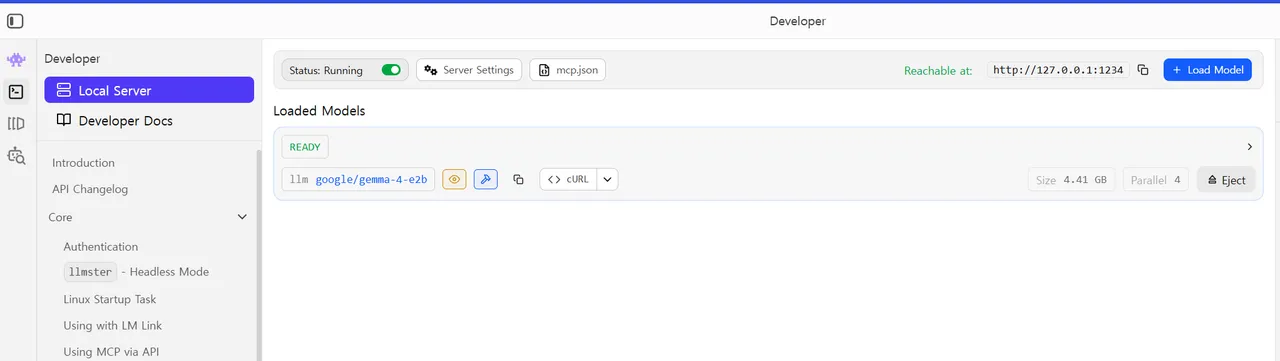

1. LM Studio의 Developer → Local Server 탭으로 이동합니다.

2. "+ Load Model" 버튼을 클릭하여 gemma-4-e4b를 선택합니다.

3. 모델이 로드되면 "Loaded Models" 목록에 표시됩니다.

4. LocalTranslator로 돌아와 다시 시도합니다.

팁: LM Studio 설정에서 "Just-in-time model loading"이 활성화되어 있으면 요청 시 자동으로 모델이 로드됩니다.

서버가 시작되지 않는 경우

LM Studio를 완전히 종료하고 다시 실행한 뒤, Developer 탭에서 서버 토글을 다시 켜보세요.

마무리

LocalTranslator + LM Studio 조합은 인터넷 연결 없이도, 그리고 외부 서버에 데이터를 보내지 않고도 AI로 번역할 수 있습니다. 특히 민감한 업무 문서나 개인 정보가 담긴 텍스트를 번역할 때 매우 유용합니다.

모델 크기가 크다 보니 첫 번역 응답까지 시간이 걸릴 수 있지만, 일단 모델이 메모리에 올라오면 이후 번역은 빠르게 처리됩니다. 더 빠른 응답이 필요하다면 더 작은 모델(예: gemma-4-e2b)을 사용해 보는 것도 좋은 선택입니다.

로그인하고 댓글을 작성하세요